Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Представляємо Liquid Nanos ⚛️ — нове сімейство надзвичайно крихітних моделей для конкретних завдань, які забезпечують продуктивність класу GPT-4o під час роботи безпосередньо на телефонах, ноутбуках, автомобілях, вбудованих пристроях і графічних процесорах із найменшою затримкою та найвищою швидкістю генерації.

> розмір моделі: від 350 М до 2,6 В

> побудована на LFM2, нашій ефективній архітектурі моделі v2

> змагатися з моделями в сотні разів більшими

> дозволяють виконувати основні агентні завдання: точне вилучення даних, багатомовний переклад, виклик інструментів, математику та RAG. 1/п

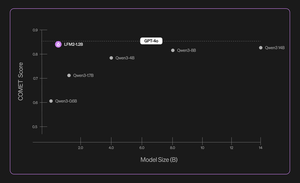

Ми використовуємо комбінацію методів для автоматизованих оцінок, дистиляції знань, RL та злиття моделей для ітеративного покращення продуктивності моделі за заданим завданням. Отримані моделі, хоч і невеликі, конкурують зі значно більшими моделями. 2/п

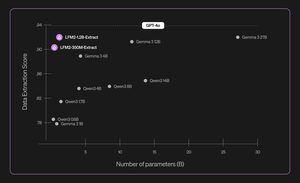

Наприклад, LFM2-350M-Extract і LFM2-1.2B-Extract призначені для вилучення важливої інформації з широкого спектру неструктурованих документів (таких як статті, стенограми або звіти) у структуровані виводи, такі як JSON, XML або YAML. Вони сумісні з англійською, арабською, китайською, французькою, німецькою, японською, корейською, португальською та іспанською мовами.

Наші моделі вилучення даних забезпечують значне підвищення достовірності, точності та точності. Наприклад, LFM2-1.2B-Extract може виводити складні об'єкти на різних мовах на рівні, що вище, ніж Gemma 3 27B, модель у 22,5 рази більша за неї та наближається до її продуктивності до GPT-4o. 3/п

У нашому початковому релізі ми анонсуємо шість Nano для конкретних завдань:

> LFM2-Extract – багатомовна модель на 350 млн і 1,2 млрд для вилучення даних із неструктурованого тексту, наприклад, перетворення листів із рахунками на об'єкти JSON.

> LFM2-350M-ENJP-MT – модель 350M для двонаправленого перекладу на англійську ↔ японську мову.

> LFM2-1.2B-RAG – модель 1.2B, оптимізована для відповідей на запитання з довгим контекстом у конвеєрах RAG.

> LFM2-1.2B-Tool – модель 1.2B, створена для виклику функцій та використання агентських інструментів.

> LFM2-350M-Math – 350-метрова модель міркувань для розв'язання математичних задач.

4/п

«Я вважаю дуже вражаючим те, що нова техніка Liquid до та після тренування дозволяє їхнім швидким і маленьким LLM працювати нарівні з frontier моделями, такими як GPT-4o, який на порядок більший, у спеціалізованих завданнях», — сказав Михайло Парахін (@MParakhin), технічний директор Shopify. «Liquid одночасно піднімає планку як продуктивності, так і швидкості в базових моделях, виходячи за рамки сучасного стану. Ось чому ми раді використовувати їхні моделі на всіх платформах і сервісах Shopify». 5/п

«Компанія «Делойт» у захваті від можливості співпрацювати з Liquid AI та їхньою новою моделлю Nanos, яка має потенціал для підвищення продуктивності, порівнянної з більшими моделями, за нижчою ціною», – сказав Ранджит Бава (@ronbawa), директор зі стратегії та технологій Deloitte у США.

«Nanos від Liquid є потужною точкою перегину для ПК зі штучним інтелектом, забезпечуючи продуктивність на передньому рівні в компактній, енергоефективній формі. У AMD ми поділяємо цей фокус на лідерстві за показником продуктивності на ват і розглядаємо інтелект на пристроях як ключ до широкого та сталого масштабування штучного інтелекту», — сказав Марк Пейпермастер (@mpaper2000), технічний директор і виконавчий віце-президент AMD. 7/п

139,59K

Найкращі

Рейтинг

Вибране