Subiecte populare

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Vă prezentăm Liquid Nanos ⚛️ - o nouă familie de modele extrem de mici specifice sarcinilor care oferă performanțe de clasă GPT-4o în timp ce rulează direct pe telefoane, laptopuri, mașini, dispozitive încorporate și GPU-uri cu cea mai mică latență și cea mai rapidă viteză de generare.

> dimensiunea modelului: 350M până la 2.6B

> construit pe LFM2, arhitectura noastră de model eficientă v2

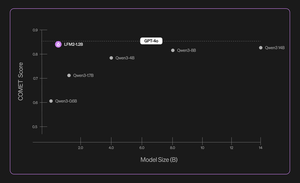

> performa competitiv cu modele de până la sute de ori mai mari

> permite sarcini agentice de bază: extragerea precisă a datelor, traducerea multilingvă, apelarea instrumentelor, matematică și RAG. 1/n

Folosim o combinație de metode pentru evaluări automate, distilarea cunoștințelor, RL și fuzionarea modelelor pentru a îmbunătăți iteriv performanța unui model la o anumită sarcină. Modelele rezultate, deși mici, funcționează competitiv față de modelele substanțial mai mari. 2/n

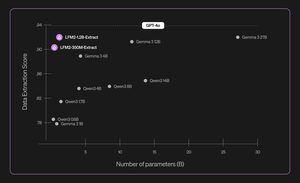

De exemplu, LFM2-350M-Extract și LFM2-1.2B-Extract sunt concepute pentru a extrage informații importante dintr-o mare varietate de documente nestructurate (cum ar fi articole, transcrieri sau rapoarte) în ieșiri structurate precum JSON, XML sau YAML. Sunt compatibile cu intrările în engleză, arabă, chineză, franceză, germană, japoneză, coreeană, portugheză și spaniolă.

Modelele noastre de extragere a datelor oferă o creștere semnificativă a validității, acurateței și fidelității. De exemplu, LFM2-1.2B-Extract poate scoate obiecte complexe în diferite limbi la un nivel mai mare decât Gemma 3 27B, un model de 22,5 ori mai mare decât dimensiunea sa și care se apropie de performanța sa de GPT-4o. 3/n

Anunțăm șase Nanos specifice sarcinii în versiunea noastră inițială:

> LFM2-Extract – Un model multilingv de 350M și 1.2B pentru extragerea datelor din text nestructurat, cum ar fi transformarea e-mailurilor de factură în obiecte JSON.

> LFM2-350M-ENJP-MT – UN MODEL 350M pentru traducerea bidirecțională engleză ↔ japoneză.

> LFM2-1.2B-RAG – Un model 1.2B optimizat pentru răspunsul la întrebări cu context lung în conductele RAG.

> LFM2-1.2B-Tool – Un model 1.2B construit pentru apelarea funcțiilor și utilizarea instrumentelor agentice.

> LFM2-350M-Math – Un model de raționament 350M pentru rezolvarea problemelor matematice.

4/n

"Mi se pare foarte impresionant faptul că noua tehnică de pre-antrenament și post-antrenament a Liquid permite LLM-urilor lor rapide și mici să funcționeze la egalitate cu modelele de frontieră, cum ar fi GPT-4o, care este cu ordine de mărime mai mare, pe sarcini specializate", a declarat Mikhail Parakhin (@MParakhin), CTO, Shopify. "Liquid ridică simultan ștacheta atât pentru performanță, cât și pentru viteză în modelele de fundație, depășind stadiul de ultimă generație. De aceea, suntem încântați să le folosim modelele pe platformele și serviciile Shopify." 5/n

"Deloitte este încântată de oportunitatea de a colabora cu Liquid AI și noul lor model Nanos, care are potențialul de a genera performanțe comparabile cu modelele mai mari la un cost mai mic", a declarat Ranjit Bawa (@ronbawa), Chief Strategy and Technology Officer, Deloitte U.S. 6/n

"Nanos de la Liquid reprezintă un punct de inflexiune puternic pentru PC-urile AI, oferind performanțe la nivel de frontieră într-o formă compactă și eficientă din punct de vedere energetic. La AMD, împărtășim acest accent pe conducerea performanței pe watt și vedem inteligența de pe dispozitiv ca fiind cheia pentru scalarea AI pe scară largă și durabilă", a declarat Mark Papermaster (@mpaper2000), CTO și EVP, AMD. 7/n

561,1K

Limită superioară

Clasament

Favorite