Populaire onderwerpen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Artificial Analysis

Onafhankelijke analyse van AI-modellen en hostingproviders - kies het beste model en de beste API-provider voor uw use-case

DeepSeek lanceert V3.1, die V3 en R1 verenigt in een hybride redeneermodel met een incrementele toename in intelligentie

Incrementele toename in intelligentie: De eerste benchmarkresultaten voor DeepSeek V3.1 tonen een Artificial Analysis Intelligence Index van 60 in redeneermodus, een stijging ten opzichte van de score van 59 van R1. In niet-redeneermodus behaalt V3.1 een score van 49, een grotere stijging ten opzichte van de eerdere V3 0324 score van 44. Dit laat V3.1 (redenerend) achter bij Alibaba's nieuwste Qwen3 235B 2507 (redenerend) - DeepSeek heeft de leiding niet teruggenomen.

Hybride redenering: @deepseek_ai is voor het eerst overgestapt op een hybride redeneermodel - dat zowel redenerende als niet-redenerende modi ondersteunt. DeepSeek's overstap naar een verenigd hybride redeneermodel imiteert de aanpak van OpenAI, Anthropic en Google. Het is echter interessant op te merken dat Alibaba onlangs hun hybride aanpak, die ze voor Qwen3 favoriseerden, heeft verlaten met hun aparte releases van Qwen3 2507 redenerings- en instructiemodellen.

Functieaanroep / toolgebruik: Hoewel DeepSeek verbeterde functieaanroepen voor het model claimt, ondersteunt DeepSeek V3.1 geen functieaanroepen in redeneermodus. Dit zal waarschijnlijk de mogelijkheid om agentische workflows met intelligentie-eisen te ondersteunen, aanzienlijk beperken, inclusief in coderingsagenten.

Tokengebruik: DeepSeek V3.1 scoort incrementeel hoger in redeneermodus dan DeepSeek R1, en gebruikt iets minder tokens in de evaluaties die we gebruiken voor de Artificial Analysis Intelligence Index. In niet-redeneermodus gebruikt het iets meer tokens dan V3 0324 - maar nog steeds meerdere keren minder dan in zijn eigen redeneermodus.

API: DeepSeek's eerste partij API bedient nu het nieuwe DeepSeek V3.1 model op zowel hun chat- als redeneereindpunten - simpelweg door te veranderen of de einddenkende </think> token aan het model in de chattemplate wordt gegeven om te controleren of het model zal redeneren.

Architectuur: DeepSeek V3.1 is architectonisch identiek aan de eerdere V3 en R1 modellen, met 671B totale parameters en 37B actieve parameters.

Gevolgen: We zouden voorzichtig zijn met het maken van aannames over wat deze release impliceert over DeepSeek's vooruitgang naar een toekomstig model dat in geruchten V4 of R2 wordt genoemd. We merken op dat DeepSeek eerder het laatste model dat is gebouwd op hun V2-architectuur op 10 december 2024 heeft vrijgegeven, slechts twee weken voordat ze V3 uitbrachten.

71,16K

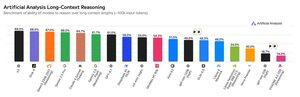

Aankondiging van Artificial Analysis Long Context Reasoning (AA-LCR), een nieuwe benchmark om de prestaties op lange context te evalueren door de redeneervaardigheden te testen over meerdere lange documenten (~100k tokens)

De focus van AA-LCR is om echt kenniswerk en redeneeropdrachten te repliceren, waarbij de capaciteit wordt getest die cruciaal is voor moderne AI-toepassingen die documentanalyse, codebase-begrip en complexe multi-stap workflows bestrijken.

AA-LCR bestaat uit 100 moeilijke tekstgebaseerde vragen die redeneervaardigheden vereisen over meerdere echte documenten die ~100k invoertokens vertegenwoordigen. Vragen zijn zo ontworpen dat antwoorden niet direct kunnen worden gevonden, maar moeten worden afgeleid uit meerdere informatiebronnen, waarbij menselijke tests verifiëren dat elke vraag echte inferentie vereist in plaats van retrieval.

Belangrijke punten:

➤ De huidige toonaangevende modellen behalen ~70% nauwkeurigheid: de top drie plaatsen gaan naar OpenAI o3 (69%), xAI Grok 4 (68%) en Qwen3 235B 2507 Thinking (67%)

➤👀 We hebben ook al gpt-oss resultaten! 120B presteert dicht bij o4-mini (hoog), in lijn met de claims van OpenAI over modelprestaties. We zullen binnenkort een Intelligence Index voor de modellen volgen.

➤ 100 moeilijke tekstgebaseerde vragen die 7 categorieën van documenten bestrijken (Bedrijfsrapporten, Sectorrapporten, Overheidsconsultaties, Academisch, Juridisch, Marketingmateriaal en Enquêteverslagen)

➤ ~100k tokens invoer per vraag, waarbij modellen een minimum van 128K contextvenster moeten ondersteunen om op deze benchmark te scoren

➤ ~3M totale unieke invoertokens die ~230 documenten beslaan om de benchmark uit te voeren (uitvoertokens variëren doorgaans per model)

➤ Link naar dataset op 🤗 @HuggingFace is hieronder

We voegen AA-LCR toe aan de Artificial Analysis Intelligence Index en verhogen het versienummer naar v2.2. Artificial Analysis Intelligence Index v2.2 omvat nu: MMLU-Pro, GPQA Diamond, AIME 2025, IFBench, LiveCodeBench, SciCode en AA-LCR.

Alle cijfers zijn nu bijgewerkt op de site. Ontdek welke modellen de Artificial Analysis Intelligence Index v2.2 👇

28,87K

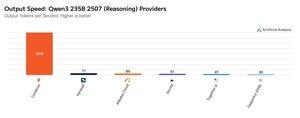

Cerebras heeft deze week zijn vermogen gedemonstreerd om grote MoE's met zeer hoge snelheden te hosten, met de lancering van Qwen3 235B 2507 en Qwen3 Coder 480B eindpunten met >1.500 output tokens/s

➤ @CerebrasSystems biedt nu eindpunten voor zowel Qwen3 235B 2507 Redeneren & Niet-redeneren. Beide modellen hebben 235B totale parameters met 22B actief.

➤ Qwen 3 235B 2507 Redeneren biedt intelligentie vergelijkbaar met o4-mini (hoog) & DeepSeek R1 0528. De Niet-redeneren variant biedt intelligentie vergelijkbaar met Kimi K2 en ver boven GPT-4.1 en Llama 4 Maverick.

➤ Qwen3 Coder 480B heeft 480B totale parameters met 35B actief. Dit model is bijzonder sterk voor agentic coding en kan worden gebruikt in een verscheidenheid aan coding agent tools, waaronder de Qwen3-Coder CLI.

De lanceringen van Cerebras vertegenwoordigen de eerste keer dat dit niveau van intelligentie toegankelijk is geweest bij deze output snelheden en hebben het potentieel om nieuwe gebruikstoepassingen te ontgrendelen - zoals het gebruik van een redeneringsmodel voor elke stap van een agent zonder minuten te hoeven wachten.

25,34K

Boven

Positie

Favorieten