Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Artificial Analysis

Unabhängige Analyse von KI-Modellen und Hosting-Providern - wählen Sie das beste Modell und den besten API-Anbieter für Ihren Anwendungsfall

DeepSeek startet V3.1 und vereint V3 und R1 in ein hybrides Denkmodell mit einem schrittweisen Anstieg der Intelligenz

Schrittweiser Anstieg der Intelligenz: Erste Benchmarking-Ergebnisse für DeepSeek V3.1 zeigen einen Artificial Analysis Intelligence Index von 60 im Denkmodus, gegenüber einem Wert von 59 für R1. Im Nicht-Denkmodus erreicht V3.1 einen Wert von 49, was einen größeren Anstieg gegenüber dem früheren V3 0324-Wert von 44 darstellt. Damit bleibt V3.1 (Denkmodus) hinter Alibabas neuestem Qwen3 235B 2507 (Denkmodus) zurück - DeepSeek hat die Führung nicht zurückerobert.

Hybrides Denken: @deepseek_ai hat zum ersten Mal ein hybrides Denkmodell eingeführt - das sowohl Denk- als auch Nicht-Denkmodi unterstützt. Der Schritt von DeepSeek zu einem einheitlichen hybriden Denkmodell ahmt den Ansatz von OpenAI, Anthropic und Google nach. Es ist jedoch interessant zu bemerken, dass Alibaba kürzlich ihren hybriden Ansatz, den sie für Qwen3 bevorzugten, mit den separaten Veröffentlichungen von Qwen3 2507 Denk- und Instruktionsmodellen aufgegeben hat.

Funktionsaufrufe / Werkzeugnutzung: Während DeepSeek eine verbesserte Funktionsaufrufunterstützung für das Modell beansprucht, unterstützt DeepSeek V3.1 keine Funktionsaufrufe im Denkmodus. Dies wird wahrscheinlich die Fähigkeit erheblich einschränken, agentische Workflows mit Intelligenzanforderungen zu unterstützen, einschließlich in Codierungsagenten.

Token-Nutzung: DeepSeek V3.1 erzielt im Denkmodus schrittweise höhere Werte als DeepSeek R1 und verwendet in den Bewertungen, die wir für den Artificial Analysis Intelligence Index verwenden, leicht weniger Tokens. Im Nicht-Denkmodus verwendet es leicht mehr Tokens als V3 0324 - aber immer noch mehrere Male weniger als im eigenen Denkmodus.

API: Die First-Party-API von DeepSeek bedient jetzt das neue DeepSeek V3.1-Modell sowohl an ihren Chat- als auch an den Denk-Endpunkten - indem einfach geändert wird, ob das End-Denk-</think>-Token im Chat-Template an das Modell übergeben wird, um zu steuern, ob das Modell denken wird.

Architektur: DeepSeek V3.1 ist architektonisch identisch mit den vorherigen V3- und R1-Modellen, mit insgesamt 671B Parametern und 37B aktiven Parametern.

Implikationen: Wir würden raten, vorsichtig zu sein, wenn es darum geht, Annahmen darüber zu treffen, was diese Veröffentlichung über DeepSeeks Fortschritte in Richtung eines zukünftigen Modells, das in Gerüchten als V4 oder R2 bezeichnet wird, impliziert. Wir stellen fest, dass DeepSeek zuvor das endgültige Modell, das auf ihrer V2-Architektur basierte, am 10. Dezember 2024 veröffentlicht hat, nur zwei Wochen bevor V3 veröffentlicht wurde.

71,15K

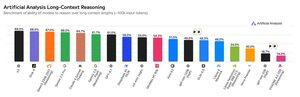

Ankündigung der Artificial Analysis Long Context Reasoning (AA-LCR), einem neuen Benchmark zur Bewertung der Leistung bei langen Kontexten durch Testen der Denkfähigkeiten über mehrere lange Dokumente (~100k Tokens)

Der Fokus von AA-LCR liegt darauf, reale Wissensarbeit und Denkaufgaben zu replizieren, die eine kritische Fähigkeit für moderne KI-Anwendungen umfassen, die Dokumentenanalyse, Codeverständnis und komplexe mehrstufige Arbeitsabläufe umfassen.

AA-LCR besteht aus 100 schwierigen textbasierten Fragen, die ein Denken über mehrere reale Dokumente erfordern, die ~100k Eingabetokens repräsentieren. Die Fragen sind so gestaltet, dass die Antworten nicht direkt gefunden werden können, sondern aus mehreren Informationsquellen abgeleitet werden müssen, wobei menschliche Tests bestätigen, dass jede Frage echte Schlussfolgerungen erfordert und nicht nur das Abrufen von Informationen.

Wichtige Erkenntnisse:

➤ Die führenden Modelle von heute erreichen eine Genauigkeit von ~70 %: Die ersten drei Plätze gehen an OpenAI o3 (69 %), xAI Grok 4 (68 %) und Qwen3 235B 2507 Thinking (67 %)

➤👀 Wir haben auch bereits gpt-oss Ergebnisse! 120B schneidet nahe an o4-mini (hoch) ab, im Einklang mit den Behauptungen von OpenAI bezüglich der Modellleistung. Wir werden in Kürze mit einem Intelligence Index für die Modelle nachlegen.

➤ 100 schwierige textbasierte Fragen, die sich über 7 Kategorien von Dokumenten erstrecken (Unternehmensberichte, Branchenberichte, Regierungsberatungen, Akademia, Recht, Marketingmaterialien und Umfrageberichte)

➤ ~100k Tokens Eingabe pro Frage, was erfordert, dass Modelle ein Mindestmaß von 128K Kontextfenster unterstützen, um in diesem Benchmark zu punkten

➤ ~3M insgesamt einzigartige Eingabetokens, die sich über ~230 Dokumente erstrecken, um den Benchmark durchzuführen (Ausgabetokens variieren typischerweise je nach Modell)

➤ Link zum Datensatz auf 🤗 @HuggingFace ist unten

Wir fügen AA-LCR zum Artificial Analysis Intelligence Index hinzu und erhöhen die Versionsnummer auf v2.2. Der Artificial Analysis Intelligence Index v2.2 umfasst jetzt: MMLU-Pro, GPQA Diamond, AIME 2025, IFBench, LiveCodeBench, SciCode und AA-LCR.

Alle Zahlen sind jetzt auf der Website aktualisiert. Finden Sie heraus, welche Modelle im Artificial Analysis Intelligence Index v2.2 👇

28,85K

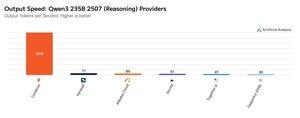

Cerebras hat diese Woche seine Fähigkeit demonstriert, große MoEs mit sehr hohen Geschwindigkeiten zu hosten, indem es die Endpunkte Qwen3 235B 2507 und Qwen3 Coder 480B mit >1.500 Ausgabetokens/s gestartet hat.

➤ @CerebrasSystems bietet jetzt Endpunkte für sowohl Qwen3 235B 2507 Reasoning als auch Non-reasoning an. Beide Modelle haben insgesamt 235B Parameter mit 22B aktiv.

➤ Qwen 3 235B 2507 Reasoning bietet eine Intelligenz, die mit o4-mini (hoch) und DeepSeek R1 0528 vergleichbar ist. Die Non-reasoning-Variante bietet eine Intelligenz, die mit Kimi K2 vergleichbar ist und weit über GPT-4.1 und Llama 4 Maverick liegt.

➤ Qwen3 Coder 480B hat insgesamt 480B Parameter mit 35B aktiv. Dieses Modell ist besonders stark für agentisches Codieren und kann in einer Vielzahl von Codierungsagenten-Tools verwendet werden, einschließlich der Qwen3-Coder CLI.

Die Starts von Cerebras stellen das erste Mal dar, dass dieses Niveau an Intelligenz zu diesen Ausgabegeschwindigkeiten zugänglich ist und das Potenzial hat, neue Anwendungsfälle zu erschließen - wie die Verwendung eines Reasoning-Modells für jeden Schritt eines Agenten, ohne Minuten warten zu müssen.

25,32K

Top

Ranking

Favoriten