Topik trending

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Artificial Analysis

Analisis independen model AI dan penyedia hosting - pilih model dan penyedia API terbaik untuk kasus penggunaan Anda

DeepSeek meluncurkan V3.1, menyatukan V3 dan R1 menjadi model penalaran hibrida dengan peningkatan kecerdasan bertahap

Peningkatan kecerdasan tambahan: Hasil pembandingan awal untuk DeepSeek V3.1 menunjukkan Indeks Kecerdasan Analisis Buatan 60 dalam mode penalaran, naik dari skor R1 59. Dalam mode non-penalaran, V3.1 mencapai skor 49, peningkatan yang lebih besar dari skor V3 0324 sebelumnya sebesar 44. Ini meninggalkan V3.1 (penalaran) di belakang Qwen3 235B 2507 terbaru Alibaba (penalaran) - DeepSeek belum memimpin kembali.

Penalaran hibrida: @deepseek_ai telah beralih ke model penalaran hibrida untuk pertama kalinya - mendukung mode penalaran dan non-penalaran. Perpindahan DeepSeek ke model penalaran hibrida terpadu meniru pendekatan yang diambil oleh OpenAI, Anthropic, dan Google. Namun, menarik untuk dicatat bahwa Alibaba baru-baru ini meninggalkan pendekatan hibrida yang mereka sukai untuk Qwen3 dengan rilis terpisah dari model penalaran dan instruksi Qwen3 2507.

Pemanggilan fungsi / penggunaan alat: Sementara DeepSeek mengklaim pemanggilan fungsi yang ditingkatkan untuk model, DeepSeek V3.1 tidak mendukung pemanggilan fungsi saat dalam mode penalaran. Hal ini kemungkinan akan secara substansial membatasi kemampuannya untuk mendukung alur kerja agen dengan persyaratan intelijen, termasuk dalam agen pengkodean.

Penggunaan token: DeepSeek V3.1 mendapat skor yang lebih tinggi secara bertahap dalam mode penalaran daripada DeepSeek R1, dan menggunakan sedikit lebih sedikit token di seluruh eval yang kami gunakan untuk Indeks Kecerdasan Analisis Buatan. Dalam mode non-penalaran, ia menggunakan sedikit lebih banyak token daripada V3 0324 - tetapi masih beberapa kali lebih sedikit daripada dalam mode penalarannya sendiri.

API: API pihak pertama DeepSeek sekarang melayani model DeepSeek V3.1 baru pada titik akhir obrolan dan penalaran mereka - cukup mengubah apakah token pemikiran akhir </think> disediakan ke model dalam templat obrolan untuk mengontrol apakah model akan beralasan.

Arsitektur: DeepSeek V3.1 secara arsitektur identik dengan model V3 dan R1 sebelumnya, dengan parameter total 671B dan parameter aktif 37B.

Implikasi: Kami akan menyarankan untuk berhati-hati dalam membuat asumsi apa pun tentang apa yang tersirat dari rilis ini tentang kemajuan DeepSeek menuju model masa depan yang disebut dalam rumor sebagai V4 atau R2. Kami mencatat bahwa DeepSeek sebelumnya merilis model terakhir yang dibangun di atas arsitektur V2 mereka pada 10 Desember 2024, hanya dua minggu sebelum merilis V3.

71,15K

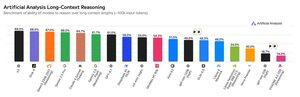

Mengumumkan Artificial Analysis Long Context Reasoning (AA-LCR), tolok ukur baru untuk mengevaluasi kinerja konteks panjang melalui pengujian kemampuan penalaran di beberapa dokumen panjang (~100k token)

Fokus AA-LCR adalah untuk mereplikasi pekerjaan pengetahuan dan tugas penalaran yang nyata, menguji kemampuan yang penting untuk aplikasi AI modern yang mencakup analisis dokumen, pemahaman basis kode, dan alur kerja multi-langkah yang kompleks.

AA-LCR adalah 100 pertanyaan berbasis teks keras yang memerlukan penalaran di beberapa dokumen dunia nyata yang mewakili ~100k token input. Pertanyaan dirancang agar jawaban tidak dapat ditemukan secara langsung tetapi harus didasarkan dari berbagai sumber informasi, dengan pengujian manusia memverifikasi bahwa setiap pertanyaan membutuhkan kesimpulan asli daripada pengambilan.

Kesimpulan utama:

➤ Model terkemuka saat ini mencapai akurasi ~70%: tiga tempat teratas jatuh ke OpenAI o3 (69%), xAI Grok 4 (68%) dan Qwen3 235B 2507 Thinking (67%)

➤ 👀 Kami juga sudah memiliki hasil gpt-oss! 120B berkinerja mendekati o4-mini (tinggi), sejalan dengan klaim OpenAI mengenai kinerja model. Kami akan segera menindaklanjuti dengan Indeks Kecerdasan untuk model.

➤ 100 pertanyaan berbasis teks keras yang mencakup 7 kategori dokumen (Laporan Perusahaan, Laporan Industri, Konsultasi Pemerintah, Akademisi, Hukum, Materi Pemasaran, dan Laporan Survei)

➤ ~100 ribu token input per pertanyaan, yang mengharuskan model untuk mendukung jendela konteks minimal 128 ribu untuk mendapatkan skor pada tolok ukur ini

➤ ~3 juta total token input unik yang mencakup ~230 dokumen untuk menjalankan tolok ukur (token output biasanya bervariasi menurut model)

➤ Tautan ke kumpulan data di 🤗 @HuggingFace ada di bawah ini

Kami menambahkan AA-LCR ke Indeks Kecerdasan Analisis Buatan, dan membawa nomor versi ke v2.2. Indeks Kecerdasan Analisis Buatan v2.2 sekarang meliputi: MMLU-Pro, GPQA Diamond, AIME 2025, IFBench, LiveCodeBench, SciCode dan AA-LCR.

Semua nomor diperbarui di situs sekarang. Cari tahu model mana Indeks Kecerdasan Analisis Buatan v2.2 👇

28,84K

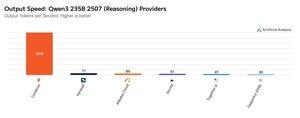

Cerebras telah menunjukkan kemampuannya untuk menampung MoE besar dengan kecepatan yang sangat tinggi minggu ini, meluncurkan titik akhir Qwen3 235B 2507 dan Qwen3 Coder 480B pada >1.500 token keluaran

➤ @CerebrasSystems sekarang menawarkan titik akhir untuk Qwen3 235B 2507 Penalaran & Non-penalaran. Kedua model memiliki parameter total 235B dengan 22B aktif.

➤ Qwen 3 235B 2507 Penalaran menawarkan kecerdasan yang sebanding dengan o4-mini (tinggi) & DeepSeek R1 0528. Varian Non-penalaran menawarkan kecerdasan yang sebanding dengan Kimi K2 dan jauh di atas GPT-4.1 dan Llama 4 Maverick.

➤ Qwen3 Coder 480B memiliki total parameter 480B dengan 35B aktif. Model ini sangat kuat untuk pengkodean agen dan dapat digunakan dalam berbagai alat agen pengkodean, termasuk CLI Qwen3-Coder.

Peluncuran Cerebras mewakili pertama kalinya tingkat kecerdasan ini dapat diakses pada kecepatan keluaran ini dan memiliki potensi untuk membuka kasus penggunaan baru - seperti menggunakan model penalaran untuk setiap langkah agen tanpa harus menunggu beberapa menit.

25,32K

Teratas

Peringkat

Favorit