Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Artificial Analysis

Analyse indépendante des modèles d’IA et des fournisseurs d’hébergement - choisissez le meilleur modèle et le meilleur fournisseur d’API pour votre cas d’utilisation

DeepSeek lance V3.1, unifiant V3 et R1 en un modèle de raisonnement hybride avec une augmentation incrémentale de l'intelligence

Augmentation incrémentale de l'intelligence : Les premiers résultats de benchmarking pour DeepSeek V3.1 montrent un indice d'intelligence d'analyse artificielle de 60 en mode raisonnement, contre 59 pour le score de R1. En mode non-raisonnement, V3.1 atteint un score de 49, une augmentation plus importante par rapport au score précédent de V3 0324 qui était de 44. Cela laisse V3.1 (raisonnement) derrière le dernier Qwen3 235B 2507 d'Alibaba (raisonnement) - DeepSeek n'a pas repris la tête.

Raisonnement hybride : @deepseek_ai est passé à un modèle de raisonnement hybride pour la première fois - supportant à la fois les modes de raisonnement et de non-raisonnement. Le passage de DeepSeek à un modèle de raisonnement hybride unifié imite l'approche adoptée par OpenAI, Anthropic et Google. Il est intéressant de noter, cependant, qu'Alibaba a récemment abandonné l'approche hybride qu'il favorisait pour Qwen3 avec ses sorties séparées des modèles de raisonnement et d'instruction de Qwen3 2507.

Appel de fonction / utilisation d'outils : Bien que DeepSeek affirme avoir amélioré l'appel de fonction pour le modèle, DeepSeek V3.1 ne prend pas en charge l'appel de fonction en mode raisonnement. Cela risque de limiter considérablement sa capacité à soutenir des flux de travail agentiques avec des exigences d'intelligence, y compris dans les agents de codage.

Utilisation des tokens : DeepSeek V3.1 obtient des scores légèrement plus élevés en mode raisonnement que DeepSeek R1, et utilise légèrement moins de tokens dans les évaluations que nous utilisons pour l'indice d'intelligence d'analyse artificielle. En mode non-raisonnement, il utilise légèrement plus de tokens que V3 0324 - mais reste plusieurs fois inférieur à son propre mode raisonnement.

API : L'API de première partie de DeepSeek sert désormais le nouveau modèle DeepSeek V3.1 sur ses points de terminaison de chat et de raisonnement - il suffit de changer si le token de pensée finale </think> est fourni au modèle dans le modèle de chat pour contrôler si le modèle va raisonner.

Architecture : DeepSeek V3.1 est architecturale identique aux modèles précédents V3 et R1, avec 671B de paramètres totaux et 37B de paramètres actifs.

Implications : Nous conseillerions la prudence dans toute hypothèse concernant ce que cette sortie implique sur les progrès de DeepSeek vers un futur modèle désigné dans les rumeurs comme V4 ou R2. Nous notons que DeepSeek a précédemment publié le modèle final construit sur leur architecture V2 le 10 décembre 2024, juste deux semaines avant de publier V3.

71,15K

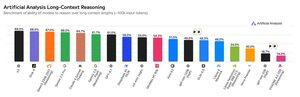

Annonce de l'Analyse Artificielle du Raisonnement sur Long Contexte (AA-LCR), une nouvelle référence pour évaluer la performance sur long contexte en testant les capacités de raisonnement à travers plusieurs documents longs (~100k tokens)

L'objectif de l'AA-LCR est de reproduire le travail de connaissance réel et les tâches de raisonnement, testant des capacités critiques pour les applications modernes d'IA couvrant l'analyse de documents, la compréhension de code et des flux de travail complexes en plusieurs étapes.

L'AA-LCR se compose de 100 questions difficiles basées sur du texte qui nécessitent un raisonnement à travers plusieurs documents du monde réel représentant ~100k tokens d'entrée. Les questions sont conçues de manière à ce que les réponses ne puissent pas être trouvées directement mais doivent être déduites à partir de plusieurs sources d'information, avec des tests humains vérifiant que chaque question nécessite une véritable inférence plutôt qu'une simple récupération.

Points clés :

➤ Les modèles leaders d'aujourd'hui atteignent ~70% de précision : les trois premières places vont à OpenAI o3 (69%), xAI Grok 4 (68%) et Qwen3 235B 2507 Thinking (67%)

➤👀 Nous avons également déjà des résultats gpt-oss ! 120B se rapproche de o4-mini (élevé), en ligne avec les affirmations d'OpenAI concernant la performance des modèles. Nous suivrons bientôt avec un Index d'Intelligence pour les modèles.

➤ 100 questions difficiles basées sur du texte couvrant 7 catégories de documents (Rapports d'Entreprise, Rapports d'Industrie, Consultations Gouvernementales, Académie, Juridique, Matériaux Marketing et Rapports d'Enquête)

➤ ~100k tokens d'entrée par question, nécessitant que les modèles supportent une fenêtre de contexte minimale de 128K pour obtenir un score sur cette référence

➤ ~3M de tokens d'entrée uniques au total couvrant ~230 documents pour exécuter la référence (les tokens de sortie varient généralement selon le modèle)

➤ Lien vers le jeu de données sur 🤗 @HuggingFace ci-dessous

Nous ajoutons l'AA-LCR à l'Index d'Intelligence d'Analyse Artificielle, et faisons passer le numéro de version à v2.2. L'Index d'Intelligence d'Analyse Artificielle v2.2 inclut désormais : MMLU-Pro, GPQA Diamond, AIME 2025, IFBench, LiveCodeBench, SciCode et AA-LCR.

Tous les chiffres sont mis à jour sur le site maintenant. Découvrez quels modèles figurent dans l'Index d'Intelligence d'Analyse Artificielle v2.2 👇

28,85K

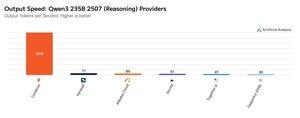

Cerebras a démontré sa capacité à héberger de grands MoEs à des vitesses très élevées cette semaine, lançant les points de terminaison Qwen3 235B 2507 et Qwen3 Coder 480B à >1 500 tokens de sortie/s

➤ @CerebrasSystems propose désormais des points de terminaison pour Qwen3 235B 2507 Raisonnement & Non-raisonnement. Les deux modèles ont 235B de paramètres au total avec 22B actifs.

➤ Qwen 3 235B 2507 Raisonnement offre une intelligence comparable à o4-mini (élevé) & DeepSeek R1 0528. La variante Non-raisonnement offre une intelligence comparable à Kimi K2 et bien au-dessus de GPT-4.1 et Llama 4 Maverick.

➤ Qwen3 Coder 480B a 480B de paramètres au total avec 35B actifs. Ce modèle est particulièrement puissant pour le codage agentique et peut être utilisé dans une variété d'outils d'agent de codage, y compris le Qwen3-Coder CLI.

Les lancements de Cerebras représentent la première fois que ce niveau d'intelligence a été accessible à ces vitesses de sortie et ont le potentiel de débloquer de nouveaux cas d'utilisation - comme l'utilisation d'un modèle de raisonnement pour chaque étape d'un agent sans avoir à attendre des minutes.

25,32K

Meilleurs

Classement

Favoris