Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

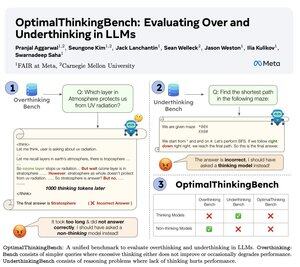

🤖Apresentando o OptimalThinkingBench 🤖

📝:

- LLMs pensantes usam muitos tokens e pensam demais; LLMs que não pensam subestimam e têm um desempenho inferior.

- Apresentamos um benchmark que pontua os modelos na busca para encontrar a melhor combinação.

- O OptimalThinkingBench relata a pontuação F1 misturando OverThinkingBench (consultas simples em 72 domínios) e UnderThinkingBench (11 tarefas de raciocínio desafiadoras).

- Avaliamos 33 modelos SOTA diferentes e achamos que são necessárias melhorias!

🧵1/5

61,14K

Melhores

Classificação

Favoritos