トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

CodecFlow

@Solana上のAIオペレーターとロボット工学の実行レイヤー

CA:69LjZUUzxj3Cb3Fxeo1X4QpYEQTboApkhXTysPpbポンプ

VLA はまだ非常に新しいものであり、多くの人が VLA と LLM の違いを理解するのが難しいと感じています。

ここでは、これらの AI システムが推論、センシング、行動においてどのように異なるかを詳しく説明します。パート 1.

主な違いと、LLM をラップする AI エージェントが VLA モデルを使用するオペレーター エージェントとどのように異なるかを詳しく見てみましょう。

1. 感覚: 彼らが世界をどのように認識するか

エージェント (LLM): テキストまたは構造化データ (JSON、API、場合によっては画像など) を処理します。それは、クリーンで抽象化された入力を扱う脳のようなものです。マニュアルを読んだり、スプレッドシートを解析したりすることを考えてみてください。構造化された環境には最適ですが、供給される内容によって制限されます。

オペレーター(VLA):カメラからの生のリアルタイムピクセルに加えて、センサーデータ(タッチ、位置など)および固有受容感覚(動きの自己認識)を確認します。それは目と感覚で世界をナビゲートするようなもので、UI や物理空間などのダイナミックで乱雑な環境で繁栄します。

2. 行動: どのように相互作用するか

エージェント: 関数、ツール、または API を呼び出して動作します。マネージャーが「Expedia API 経由でフライトを予約する」などの正確な指示を送信すると想像してください。これは意図的なものですが、事前に構築されたツールと明確なインターフェイスに依存しています。

オペレーター: マウス カーソルの移動、入力、ロボットの関節の制御など、連続した低レベルのアクションを実行します。これは熟練労働者が環境を直接操作するようなもので、リアルタイムの精度が必要なタスクに最適です。

3. コントロール: 意思決定の仕方

エージェント: 計画し、ツールを呼び出し、結果を評価し、繰り返すという、ゆっくりとした反射的なループに従います。トークンバインド(テキスト処理によって制限される)とネットワークバインド(API応答を待機)です。これにより、系統的になりますが、リアルタイムのタスクには遅くなります。

オペレーター: タイトなフィードバック ループの中で段階的な意思決定を行い、操作します。ゲーマーが画面上の内容に即座に反応するようなものだと考えてください。この速度により流体の相互作用が可能になりますが、堅牢なリアルタイム処理が必要です。

4. 学ぶべきデータ: トレーニングの原動力となるもの

エージェント: 膨大なテキストコーパス、指示、ドキュメント、または RAG (Retrieval-Augmented Generation) データセットでトレーニングされています。本、コード、またはFAQから学習し、構造化された知識よりも推論することに優れています。

オペレーター: デモンストレーション (人間がタスクを実行するビデオなど)、遠隔操作ログ、または報酬信号から学習します。これは見たり練習したりすることで学ぶようなもので、明示的な指示が不足するタスクに最適です。

5. 故障モード: 壊れる場所

エージェント: 幻覚 (答えをでっち上げる) や、1 つのステップが失敗すると崩壊する脆い長期計画に陥りやすい。それは、状況を考えすぎたり、読み間違えたりする戦略家のようなものです。

演算子: 共変量シフト (トレーニング データが現実世界の条件と一致しない場合) または制御の複合エラー (小さなミスが雪だるま式に増える) に直面します。それは、ドライバーが見知らぬ道路でコントロールを失うようなものです。

6. インフラ: その背後にある技術

エージェント: 呼び出すツールを決定するプロンプト/ルーター、使用可能な関数のツール レジストリ、コンテキストのメモリ/RAG に依存します。これは、タスクを調整するコマンド センターのようなモジュール式セットアップです。

オペレーター: ビデオ取り込みパイプライン、リアルタイム制御のためのアクションサーバー、有害なアクションを防ぐための安全シールド、エクスペリエンスを保存するためのリプレイバッファが必要です。動的な環境向けに構築された高性能システムです。

7. それぞれが輝く場所: 彼らのスイートスポット

エージェント: クリーンな API (ビジネス プロセスの自動化など)、ドキュメントの推論 (レポートの要約など)、またはコード生成を備えたワークフローを支配します。構造化された高レベルのタスクに最適です。

オペレーター: 不格好な UI の操作、ロボットの制御、ゲームのようなタスクへの取り組みなど、乱雑で API のない環境で優れています。予測不可能なシステムとのリアルタイムの対話を伴う場合、VLA は王様です。

8. メンタルモデル: プランナー + 実行者

LLM エージェントは、複雑なタスクを明確で論理的な目標に分割するプランナーと考えてください。

VLA Operator は実行者であり、ピクセルまたは物理システムと直接対話することでこれらの目標を実行します。チェッカー (別のシステムまたはエージェント) は、成功を確実にするために結果を監視します。

$CODEC

18.39K

Codecflow Optrは、デジタル環境と物理環境で見、推論し、行動するエージェントを構築するための統一されたアプローチを提供します。デスクトップワークフローの自動化、ロボットアームの制御、シミュレーションでのテストなど、同じメンタルモデルとプリミティブを使用します。

Louround 🥂8月21日 04:10

強気相場の押し目は、特に大きな触媒を持つプロジェクトでは買うことを意図しています

AI が昨年 ai16z と Virtuals によって始まったこのサイクルの物語であることは誰もが知っています。

私の賭けは、市場は VLA などのより複雑で洗練されたテクノロジーに焦点を当てるでしょうが、その理由をお話ししましょう。

LLM (大規模言語モデル) は主にテキストの読み書きを行い、説明、計画、命令の生成には優れていますが、それ自体でモーターを制御したり、物理世界と対話したりすることはありません (ChatGPT で経験したことがあるかもしれません)。

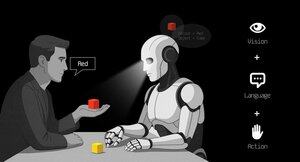

VLA (Vision Language Action models) は、物事 (視覚) を見て、指示 (言語) を理解し、アクションを直接生成するマルチモーダル システムであるため、LLM とは異なります。ロボットに赤いカップを拾うように言い、腕を動かしてそれを行うようなものです。

VLAは、画像/ビデオ+命令+実際のアクショントレース(ロボットが実際にどのように動いたか)を組み合わせた例でトレーニングされ、リアルタイムで高速かつ安全に実行する必要があります。LLM は膨大なテキスト コレクションでトレーニングされ、推論と言語タスクに重点を置いています。

TL;DR LLM は、VLA が見、推論し、行動している間に考え、話します。

ご覧のとおり、VLA は LLM への主要な追加であり、特にロボット工学である経済全体における次の 0 対 1 のイノベーションを可能にします。投資ファンドの大多数は、AI業界における次の論理的な進化と見なされているこの分野に投資の大部分を割り当てています。

私はすでに少し前に、仮想通貨市場の現在のリーダーである@codecopenflowについて投稿しましたが、同社は資金を調達していません(公正な立ち上げ)が、最先端の製品を出荷しており、現在$23M FDVに座っています。

参考までに、他の仮想通貨競合他社は、おそらく$200Mから$300M ++ FDVで$20m(@openmind_agi)を調達しましたが、製品やコミュニティはまだ構築および出荷されていません。

Codec がこの分野の主要なプロジェクトである理由は、ロボット工学と AI における重要なボトルネック、つまりすべての AI ツールを連携させることの難しさに取り組んでいることです。説明しましょう。

同社の最新リリースであるOPTR(オペレーター)は、ロボット、デスクトップ、ブラウザ、シミュレーションなどの複数のプラットフォームで対話できるオペレーターを構築するのに役立つツールキットです。オペレーターの目的は、デジタル (コンピューター) と物理 (ロボット) の両方の世界で見、推論し、行動 (VLA) することです。

このツールキットは、Web ブラウザ、シミュレーション、またはロボット用に個別のエクスペリエンスではなく、統一されたエクスペリエンスを提供することで、製品をテストし、プロセス全体を強化することを目指すロボット チームのコア インフラストラクチャとして機能します。これにより、オペレーターは基本的に環境に関係なく適応力と自律性を発揮します。

したがって、以前は各ステップを手動で実行する必要があった企業や開発者の時間を大幅に節約し、時間を節約できる場所ではコストを節約できます。

また、Codecは独自のオペレータープロジェクトを構築し、特にマーケットプレイスを通じて、新しい容量を比較的迅速に市場に投入できるようになります。

TL;DR: ロボットがティッシュを折りたたんだり、箱を仕分けたり、さまざまな要素に飛び乗ったりするビデオを見たことがあるでしょう。これらはすべて、この非常に特殊なユースケース向けにトレーニングされており、残念ながら、あるスキルを人間のように別の環境で再利用することはできません。CodecのOPTRは、環境や状況間でスキルを移行できるようにすることでこれを解決し、企業のトレーニングと開発を大幅に迅速かつ安価にします。

これが、Codec がデジタル世界と物理世界を統合する上で非常に興味深い理由です。

$CODEC、コード化されています。

2.34K

RoboMoveは、CodecFlowインフラストラクチャのみを利用したショーケースです。

別途のトークンはありません。$CODECはエコシステム内の唯一のトークンです。

@RoboMoveは、CodecFlow 演算子で可能なことの一例にすぎません。

間もなく、開発者は SDK とツールを使用して CodecFlow 上で独自の高度なシステムを構築できるようになります。

このプラットフォームは意図的にオープンで拡張可能であり、ロボット制御から GUI 自動化まで無限のユースケースを可能にします。

⚠️ 偽のトークンや模倣者に騙されないでください。常に公式の情報源から確認してください。

3.83K

中国のコミュニティがCodecFlowに気づき、私たちが構築しているものを気に入ってくれていることをうれしく思います。

ようこそ。 私たちはまだ始まったばかりです。 これからもたくさんあります。

0xFunky2025年7月13日

PUMPのパブリックセールが終わって、もともと私もBybitで大量に、チェーンの1/2だけだった、結局、チェーンだけが成功し、幸いにも事前にヘッジはなかった...

最近、AIコミュニティではVLA(Vision-Language-Action)について多くの議論が交わされています

特に、チェーン上でVLA関連のプロジェクトをやっている人はいないか調べに行ったのですが、このCodecFlow@Codecopenflowプロジェクトを見て少し購入しました。

== CodecFlowは何をしているのか ==

AIが「話す」だけでなく「行う」ことを可能にするモデルアーキテクチャであるVLAの簡単な紹介。

従来のLLM(GPTなど)は、言語を理解して提案することしかできませんが、ハンズオン、画面のクリック、オブジェクトのつかみ合いはできません。

VLA モデルは、次の 3 つの機能を統合していることを意味します。

1. ビジョン:画像、スクリーンショット、カメラ入力、またはセンサーデータを理解する

2.言語:人間の自然言語の指示を理解する

3. アクション: マウスのクリック、キーボード入力、ロボットアームの制御などの実行可能コマンドを生成します

CodecFlowはチェーン上でVLAを行っており、すべてのプロセスをチェーンにアップロードすることもでき、監査、検証、および決済できます。

簡単に言えば、「AIボット」のインフラです。

== なぜこのアイテムに特別な注意を払っているのですか? ==

彼らの開発者は、VLAスペースで最もホットなオープンソースプロジェクトであるLeRobotのコアコントリビューターであることがわかりました。

LeRobotは、SmolVLAなどのラップトップで実行できる軽量VLAを含む、オープンソースの世界でVLAモデルを構築するためのトップベースです。

これは、このチームがVlAアーキテクチャとロボットを本当に理解していることを意味します。

彼らも構築を続けており、通貨の価格も着実に上昇しているのがわかります、私はVLAトラックについて非常に楽観的であり、全体的な傾向から、VLAとロボットは確かに市場の未来です。

• Web2の巨人(Google、Meta、Tesla)は、現在、VLAとボットのトレーニングに全力で取り組んでいます。

• Web3プロジェクトは、タスクを実行できるVLAアプリケーションが不足している

• VLAは、DePIN、Web Automation、オンチェーンAIエージェントの実行などのシナリオで大きな役割を果たす機会があります。

CA:69LjZUUzxj3Cb3Fxeo1X4QpYEQTboApkhXTysPpbpump

常にDYOR。

4.08K

トップ

ランキング

お気に入り

Trending onchain

Trending on X

Recent top fundings

Most notable