Temas en tendencia

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

CodecFlow

Capa de ejecución para operadores de IA y robótica en @Solana

CA:69LjZUUzxj3Cb3Fxeo1X4QpYEQTboApkhXTysPpbpump

Los VLA son todavía muy nuevos y a mucha gente le resulta difícil entender la diferencia entre los VLA y los LLM.

Aquí hay una inmersión profunda en cómo estos sistemas de IA difieren en razonamiento, detección y acción. Parte 1.

Analicemos las distinciones clave y cómo los agentes de IA envueltos alrededor de un LLM difieren de los agentes operadores que usan modelos VLA:

1. Sentido: Cómo perciben el mundo

Agente (LLM): Procesa texto o datos estructurados, por ejemplo, JSON, API y, a veces, imágenes. Es como un cerebro que trabaja con entradas limpias y abstractas. Piense en leer un manual o analizar una hoja de cálculo. Ideal para entornos estructurados, pero limitado por lo que se le proporciona.

Operador (VLA): ve píxeles sin procesar en tiempo real de las cámaras, además de datos del sensor (por ejemplo, tacto, posición) y propiocepción (autoconciencia del movimiento). Es como navegar por el mundo con ojos y sentidos, prosperando en entornos dinámicos y desordenados como interfaces de usuario o espacios físicos.

2. Actuar: cómo interactúan

Agente: Actúa llamando a funciones, herramientas o API. Imagínelo como un gerente que envía instrucciones precisas como "reservar un vuelo a través de la API de Expedia". Es deliberado, pero se basa en herramientas prediseñadas e interfaces claras.

Operador: Ejecuta acciones continuas de bajo nivel, como mover el cursor del mouse, escribir o controlar las articulaciones del robot. Es como un trabajador calificado que manipula directamente el entorno, ideal para tareas que requieren precisión en tiempo real.

3. Control: cómo toman decisiones

Agente: Sigue un bucle lento y reflexivo: planificar, llamar a una herramienta, evaluar el resultado, repetir. Está vinculado a tokens (limitado por el procesamiento de texto) y a la red (esperando respuestas de API). Esto lo hace metódico pero lento para las tareas en tiempo real.

Operador: Opera, tomando decisiones paso a paso en un estrecho ciclo de retroalimentación. Piense en ello como un jugador que reacciona instantáneamente a lo que está en la pantalla. Esta velocidad permite la interacción de fluidos, pero exige un procesamiento robusto en tiempo real.

4. Datos para aprender: qué alimenta su entrenamiento

Agente: Entrenado en vastos corpus de texto, instrucciones, documentación o conjuntos de datos RAG (Retrieval-Augmented Generation). Aprende de libros, código o preguntas frecuentes, sobresaliendo en el razonamiento sobre el conocimiento estructurado.

Operador: Aprende de demostraciones (por ejemplo, videos de humanos realizando tareas), registros de teleoperación o señales de recompensa. Es como aprender observando y practicando, perfecto para tareas donde las instrucciones explícitas son escasas.

5. Modos de falla: dónde se rompen

Agente: Propenso a la alucinación (inventar respuestas) o planes frágiles a largo plazo que se desmoronan si falla un paso. Es como un estratega que piensa demasiado o malinterpreta la situación.

Operador: se enfrenta a un cambio de covariable (cuando los datos de entrenamiento no coinciden con las condiciones del mundo real) o a errores compuestos en el control (pequeños errores que se convierten en una bola de nieve). Es como un conductor que pierde el control en una carretera desconocida.

6. Infra: la tecnología detrás de ellos

Agente: se basa en un prompt/router para decidir a qué herramientas llamar, un registro de herramientas para las funciones disponibles y memoria/RAG para el contexto. Es una configuración modular, como un centro de comando que orquesta tareas.

Operador: necesita canalizaciones de ingesta de vídeo, un servidor de acciones para el control en tiempo real, un escudo de seguridad para evitar acciones dañinas y un búfer de reproducción para almacenar experiencias. Es un sistema de alto rendimiento diseñado para entornos dinámicos.

7. Donde brilla cada uno: sus puntos dulces

Agente: Domina los flujos de trabajo con API limpias (por ejemplo, automatización de procesos comerciales), razonamiento sobre documentos (por ejemplo, resumen de informes) o generación de código. Es su opción para tareas estructuradas y de alto nivel.

Operador: Sobresale en entornos desordenados y sin API, como navegar por interfaces de usuario torpes, controlar robots o abordar tareas similares a las de un juego. Si implica interacción en tiempo real con sistemas impredecibles, VLA es el rey.

8. Modelo mental: planificador + hacedor

Piense en el agente de LLM como el planificador: divide tareas complejas en objetivos claros y lógicos.

El operador VLA es el hacedor, ejecutando esos objetivos interactuando directamente con píxeles o sistemas físicos. Un verificador (otro sistema o agente) monitorea los resultados para garantizar el éxito.

$CODEC

32.14K

Codecflow Optr ofrece un enfoque unificado para crear agentes que ven, razonan y actúan en entornos digitales y físicos. Ya sea automatizando flujos de trabajo de escritorio, controlando brazos robóticos o probando en simulación, utiliza el mismo modelo mental y primitivas.

Louround 🥂21 ago, 04:10

Las caídas en un mercado alcista están destinadas a ser compradas, especialmente en proyectos con grandes catalizadores

Todos sabemos que la IA es la narrativa de este ciclo, iniciado por ai16z y Virtuals el año pasado.

Mi apuesta es que el mercado se centrará en tecnologías más complejas y sofisticadas, como las VLA, y déjame decirte por qué.

Los LLM (Large Language Models) leen y escriben principalmente texto: son excelentes para explicar, planificar y generar instrucciones, pero no controlan por sí mismos los motores ni interactúan con el mundo físico (como puede haber experimentado con chatgpt).

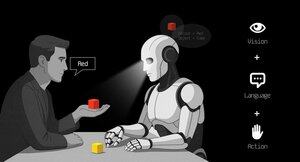

Los VLA (modelos de acción de lenguaje de visión) se diferencian de los LLM en que son sistemas multimodales que miran las cosas (visión), comprenden instrucciones (lenguaje) y producen acciones directamente. Es como decirle a un robot que tome una taza roja y luego mover su brazo para hacerlo.

Los VLA se entrenan con ejemplos que combinan imágenes / video + instrucciones + rastros de acción real (cómo se movió realmente un robot), y deben ejecutarse de manera rápida y segura en tiempo real. Los LLM, por su parte, están capacitados en grandes colecciones de texto y se enfocan en tareas de razonamiento y lenguaje.

TL; Los DR LLMs piensan y hablan mientras los VLAs ven, razonan y actúan.

Como puede ver, los VLA son una adición importante a los LLM y permitirán notablemente la próxima innovación 0 a 1 en la economía general que será la robótica. La mayoría de los fondos de inversión están destinando una gran parte de sus inversiones a este sector, visto como la próxima evolución lógica en la industria de la IA.

Ya hice una publicación hace un tiempo sobre el líder actual en el mercado de criptomonedas, @codecopenflow, que no recaudó capital (lanzamiento justo) pero está enviando productos de vanguardia y actualmente se encuentra en $ 23 millones de FDV.

Para información, otros competidores criptográficos recaudaron $ 20 millones (@openmind_agi) en lo que probablemente sea un FDV de $ 200 millones a $ 300 millones ++, mientras que aún no se ha construido ni enviado ningún producto o comunidad.

Lo que convierte a Codec en un proyecto líder en el sector es que abordan un cuello de botella crucial en la robótica y la IA, que es la dificultad de que todas las herramientas de IA interactúen juntas. Déjame explicarte.

Su última versión, OPTR (operador), es un conjunto de herramientas que ayuda a crear operadores capaces de interactuar en múltiples plataformas, como robots, escritorios, navegadores o simulaciones. El objetivo de un operador es ver, razonar y actuar (VLA) tanto en el mundo digital (computadoras) como en el físico (robots).

Este kit de herramientas sirve como infraestructura central para los equipos robóticos que buscan probar su producto y mejorar el proceso general al proporcionar una experiencia unificada en lugar de una experiencia separada para navegadores web, simulaciones o robots. Básicamente, esto hace que el operador sea adaptable y autónomo independientemente de su entorno.

Así que lo consigues, ahorrará mucho tiempo a las empresas y desarrolladores que antes tenían que pasar por cada paso manualmente y donde puedes ahorrar tiempo puedes ahorrar dinero.

También permitirá a Codec construir sus propios proyectos de operador y lanzar nuevas capacidades relativamente rápido al mercado, especialmente a través de su mercado.

TL; DR: Probablemente hayas visto videos de robots doblando tejidos, clasificando cajas o saltando sobre varios elementos. Todos han sido entrenados para este caso de uso muy específico y, desafortunadamente, una habilidad no se puede reutilizar en otro entorno como lo haría un humano. OPTR de Codec resuelve esto al hacer que las habilidades sean transferibles entre entornos y situaciones, lo que hace que la capacitación y el desarrollo sean mucho más rápidos y económicos para las empresas.

Es por eso que Codec es tan interesante para unificar el mundo digital con el mundo físico.

$CODEC, codificado.

2.8K

La firma de investigación @epochbiz (por @ZoomerOracle) publicó un artículo de investigación detallado sobre CodecFlow.

No te lo pierdas.

$CODEC

epoch_19 ago, 21:07

$CODEC se está configurando para ser la mejor opción como juego en cadena para la robótica

El artículo de investigación sobre @codecopenflow ya está disponible en 🤖

3.87K

Populares

Ranking

Favoritas