Topik trending

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Akshay 🚀

Menyederhanakan LLM, Agen AI, RAG, dan Pembelajaran Mesin untuk Anda! • Co-founder @dailydoseofds_• BITS Pilani • 3 Paten • mantan Insinyur AI @ LightningAI

Perintah sistem semakin ketinggalan zaman!

Berikut adalah pelajaran yang berlawanan dengan intuisi dari membangun Agen dunia nyata:

Menulis perintah sistem raksasa tidak meningkatkan kinerja Agen; itu sering membuatnya lebih buruk.

Misalnya, Anda menambahkan aturan tentang kebijakan pengembalian dana. Kemudian satu tentang nada. Kemudian satu lagi tentang kapan harus meningkatkan. Tak lama kemudian, Anda memiliki instruksi manual 2.000 kata.

Tapi inilah yang telah kami pelajari: LLM sangat buruk dalam menangani ini.

Penelitian terbaru juga menegaskan apa yang banyak dari kita alami. Ada "Kutukan Instruksi." Semakin banyak aturan yang Anda tambahkan ke perintah, semakin buruk kinerja model dalam mengikuti salah satu aturan.

Berikut adalah pendekatan yang lebih baik: pedoman bersyarat kontekstual.

Alih-alih satu prompt raksasa, pecahkan instruksi Anda menjadi potongan-potongan modular yang hanya dimuat ke LLM jika relevan.

```

agent.create_guideline(

condition="Pelanggan menanyakan pengembalian dana",

action="Periksa status pesanan terlebih dahulu untuk melihat apakah memenuhi syarat",

alat=[check_order_status],

)

```

Setiap pedoman memiliki dua bagian:

- Kondisi: Kapan dimuat?

- Tindakan: Apa yang harus dilakukan agen?

Keajaiban terjadi di belakang layar. Saat kueri tiba, sistem mengevaluasi pedoman mana yang relevan dengan status percakapan saat ini.

Hanya pedoman tersebut yang dimuat ke dalam konteks model.

Ini membuat beban kognitif LLM tetap minimal karena alih-alih menyulap 50 aturan, ia berfokus pada hanya 3-4 yang benar-benar penting pada saat itu.

Ini menghasilkan pengikut instruksi yang jauh lebih baik.

Pendekatan ini disebut Pemodelan Penyelarasan. Menyusun panduan secara kontekstual sehingga agen tetap fokus, konsisten, dan patuh.

Alih-alih menunggu model yang diduga lebih kecil, yang penting adalah memiliki arsitektur yang menghormati cara kerja LLM pada dasarnya.

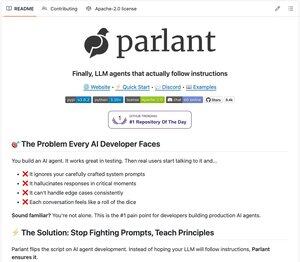

Pendekatan ini sebenarnya diterapkan di Parlant - kerangka kerja sumber terbuka yang sedang tren baru-baru ini (13k+ bintang). Anda dapat melihat implementasi lengkapnya dan mencobanya sendiri.

Tetapi wawasan inti berlaku terlepas dari alat apa yang Anda gunakan:

Jadilah lebih metodis tentang rekayasa konteks dan benar-benar menjelaskan apa yang Anda harapkan perilaku dalam kasus khusus yang Anda pedulikan.

Kemudian agen bisa menjadi benar-benar fokus dan berguna.

Saya telah membagikan tautan repositori di balasan.

42,42K

Rekayasa konteks vs. rekayasa prompt:

Pada hari-hari awal LLM, membuat petunjuk cerdas adalah saus rahasia.

Tetapi jika Anda membangun agen AI yang serius hari ini, rekayasa cepat saja tidak akan memotongnya.

Anda membutuhkan rekayasa konteks.

Inilah alasannya:

- Prompting adalah tentang apa yang Anda katakan

- Rekayasa konteks adalah tentang apa yang dilihat model

Dan apa yang dilihatnya lebih penting dari sebelumnya.

Setiap token dalam konteks membutuhkan perhatian. Semakin besar konteksnya, semakin besar kemungkinan model terganggu, lupa, atau melambat.

Sama seperti manusia, LLM bisa kehilangan fokus.

Itu sebabnya agen yang baik tidak begitu saja membuang semuanya ke dalam konteks. Mereka:

1️⃣ Kurasi apa yang berguna

2️⃣ Ringkas apa yang lama

3️⃣ Ambil apa yang dibutuhkan (tepat waktu)

4️⃣ Tulis catatan untuk diri mereka sendiri

5️⃣ Mendelegasikan pekerjaan ke sub-agen bila diperlukan

Ini bukan teori, ini adalah bagaimana sistem seperti Claude Code, agen dunia nyata, dan alat memori yang efektif sudah bekerja saat ini.

Rekayasa konteks menjadi keterampilan inti bagi siapa saja yang membangun agen multi-langkah yang bercakrawala panjang.

Jika Anda serius tentang agen, mulailah memperlakukan konteks sebagai sumber daya yang terbatas dan bernilai tinggi.

Dan merekayasanya seperti itu.

Posting ini terinspirasi oleh blog terbaru Anthropic tentang topik yang sama.

Saya sangat merekomendasikan membacanya; Tautan dibagikan di tweet berikutnya!

24,51K

Kanvas seperti Figma untuk membangun & menguji alur kerja AI!

Dengan Pembuat Agen AI Postman, 100.000+ API menjadi alat bagi agen Anda.

Dan kanvas visual tanpa kode untuk membangun & menguji alur kerja AI multi-langkah dengan cepat.

Untuk memahami lebih baik, bayangkan Anda sedang membangun alur kerja dukungan pelanggan:

- Ini menerima kueri pengguna.

- Mengambil konteks yang relevan (dari percakapan sebelumnya, dokumen, dll.)

- Putuskan apakah konteksnya relevan (ini bersyarat):

→ Jika ya, itu menghasilkan respons dan mengembalikannya ke pengguna.

→ Jika tidak, itu memberi tahu tim dukungan manusia.

Seperti yang ditunjukkan dalam video di bawah ini, Anda dapat membangun alur kerja ini di dalam AI Agent Builder Postman dan menguji semua integrasi untuk memastikannya berjalan seperti yang diharapkan.

Dengan cara ini, pengembang AI hanya dapat melakukan apa yang seharusnya: membangun alur kerja agen dan meningkatkannya tanpa mengkhawatirkan tantangan integrasi dan pengujian.

Untuk memulai, periksa tautan di tweet berikutnya!

Terima kasih kepada Postman karena telah bermitra dengan saya di posting ini!

16,16K

Teratas

Peringkat

Favorit