热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

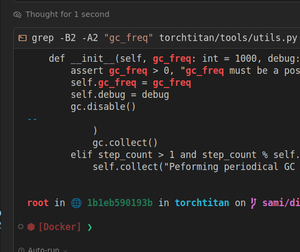

samsja

@PrimeIntellect 领先的研究

基于文本的声明性系统将会胜出,是时候重新发明计算机了

samsja8月17日 08:09

也许 llm + nixos 会通过让用户的计算机 agi 连接到操作系统,使他们的能力提升 10 倍,从而拯救 Linux。想象一下,只需问一句:"你能安装光标并将我所有的 vscode 设置转移到它上吗?"

与此同时,macos 用户仍然会使用鼠标手动下载和配置所有内容。

想要训练一个视觉模型为我点击,这种短视的想法,真的需要为 agi 重新设计一切。

2.16K

也许 llm + nixos 会通过让用户的计算机 agi 连接到操作系统,使他们的能力提升 10 倍,从而拯救 Linux。想象一下,只需问一句:"你能安装光标并将我所有的 vscode 设置转移到它上吗?"

与此同时,macos 用户仍然会使用鼠标手动下载和配置所有内容。

想要训练一个视觉模型为我点击,这种短视的想法,真的需要为 agi 重新设计一切。

samsja8月17日 07:46

nixos难道不是llm沙盒的终极游戏吗?

10.58K

RL 对数字非常敏感,上次 torch compile 导致一些运行崩溃,现在是 vllm v1

Mika Senghaas8月12日 11:23

从 vllm v0 迁移到 v1 导致我们的异步强化学习训练崩溃!阅读我们是如何解决这个问题的

我们最近从 v0 迁移到 v1,作为对 prime-rl 进行更大规模重构的一部分,以使其更易于使用、更高效,并自然支持异步。我们在许多小规模运行中确认了正确的训练动态,但在尝试重现一个在重构之前没有问题的大规模运行时遇到了瓶颈。具体来说,在我们的 INTELLECT-2 数学数据集中,使用 8k 上下文和两步离线延迟训练 DeepSeek-R1-Distill-Qwen-1.5B 解决单轮数学问题时,大约在训练进行 400 步时会致命崩溃。

6.74K

o1/o3是真正的gpt5,他们确实交付了,可能比gpt3到4的跳跃还要大,RL仍在继续遵循扩展法则。

预训练也在扩展,但使用巨型模型进行推理实在是太昂贵了。

不过我同意,开源将会胜出。

Yuchen Jin8月10日 12:04

GPT-5 两次失败。

规模法则即将结束。

开源 AI 将拥有天命。

4.37K

热门

排行

收藏

链上热点

X 热门榜

近期融资

最受认可