Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Deixe-me pintar o quadro.

Digamos que você queira que um humanóide cozinhe um jantar delicioso enquanto você se senta no sofá e assiste à Netflix.

Como isso funcionaria em um nível técnico, já que o Humanóide requer vários cérebros para fazer o seu jantar?

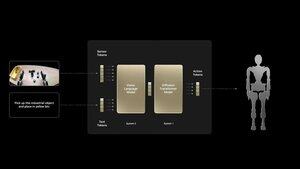

A inteligência do robô não é monolítica, mas uma equipe de módulos de IA que combinam deliberação lenta com reflexos rápidos (design do Sistema 2 + Sistema 1).

Seu modelo de visão-linguagem-ação (VLA) divide a cognição em um módulo de raciocínio e uma política de controle reativo.

Como o robô está rodando em uma arquitetura cognitiva multicerebral, ele acionaria um operador "chef" dedicado para lidar com sua solicitação, como inspecionar a cozinha com suas câmeras, procurar uma receita e direcionar seus membros para começar a cortar vegetais.

Esses cérebros podem ser divididos nos seguintes operadores.

Cérebro # 1:

Para preparar um jantar delicioso, você precisa de um planejador executivo. Ele interpreta seu comando ("preparar o jantar") para determinar o objetivo (fazer macarrão). Usando a compreensão de linguagem natural, ele decide quais subtarefas são necessárias (encontrar ingredientes, cozinhar macarrão, pôr a mesa etc.) e quais outros cérebros devem lidar com cada uma.

Coordena o sistema multiagente: ativando módulos especializados para visão, conhecimento e movimento. Este cérebro deliberativo (sistema 2) toma decisões de alto nível, estabelece a abordagem e aloca responsabilidades antes que qualquer movimento físico comece.

Cérebro #2:

Agora que você tem a receita, precisará de alguns olhos de robô e consciência espacial. Ele processa feeds de câmera para identificar ingredientes, ferramentas e suas localizações na cozinha. Usando visão computacional avançada, ele vê a tábua de cortar, os vegetais na geladeira, a faca no balcão, etc.

Ele constrói um mapa 3D do ambiente e rastreia objetos relevantes (como onde estão o sal ou as panelas). Esse cérebro perceptivo (Sistema 2) funciona mais devagar que os reflexos, mas fornece um contexto de cena preciso para o planejamento. Ao reconhecer todas as peças envolvidas, ele educa o robô no mundo real.

Cérebro #3:

Este cérebro atua como a base de conhecimento e memória do robô (Sistema 2). Ele recupera e analisa as informações necessárias para a tarefa, neste caso, uma receita adequada e instruções de cozimento. Ele pode consultar um livro de receitas on-line ou seu banco de dados interno para obter uma receita de macarrão e, em seguida, interpretar as etapas (ferver água, picar alho, etc.).

Ele lembra fatos sobre a cozinha (como onde os temperos são mantidos) e experiências culinárias anteriores. Essencialmente, fornecendo compreensão semântica e conhecimento de mundo. Em seguida, calcula instruções abstratas (caramelizar as cebolas) em parâmetros concretos (temperatura, tempo) que o robô pode executar, garantindo que o plano esteja alinhado com suas preferências.

Cérebro #4:

Com o objetivo e o ambiente esclarecidos, elaboramos um plano de jogo detalhado. Ele divide a meta de alto nível em ações ordenadas e etapas condicionais. Ele agenda tarefas (às vezes em paralelo, como pré-aquecer o forno enquanto corta legumes) e define marcos (água fervida, molho pronto).

Ele também rastreia o progresso e pode replanejar em tempo real se algo mudar (digamos que um ingrediente esteja faltando). Em seguida, ele entrega essa sequência de ação aos cérebros de nível de movimento para execução. Outro cérebro do Sistema 2.

Cérebro #5:

Hora de passar da arquitetura do Sistema 2 e passar para o Sistema 1, traduzindo o plano em movimentos concretos do robô. Para cada ação (como "caminhar até a geladeira" ou "cortar cenouras"), ela gera trajetórias aplicáveis para o corpo e os membros do robô.

Este módulo lida com o planejamento de caminho e cinemática inversa, calculando caminhos e ângulos de junta para que o robô se mova suavemente sem colisões. Ele normalmente aplica políticas motoras aprendidas (como uma política de transformador de difusão) para produzir movimentos fluidos para tarefas complexas.

Se o Cérebro 4 diz para pegar uma panela da geladeira, o Cérebro 5 descobre como levar o robô até lá e como agarrar a panela. Onde coordena vários membros quando necessário (usando as duas mãos para levantar um pote pesado, por exemplo). A intenção de alto nível se transforma em uma convergência de hardware e software se movendo em movimento

Cérebro #6:

Uma vez que um plano de movimento é definido, é hora de executar. Este cérebro de controle do Sistema 1 de baixo nível aciona os atuadores do robô (motores e articulações). Ele lê continuamente os sensores (ângulos das articulações, força, equilíbrio) e envia sinais de controle para seguir a trajetória.

Usando loops de controle (controladores PID, controle preditivo de modelo, etc.) para manter a precisão, se o robô começar a tombar ou uma faca sair do curso, ele corrige instantaneamente. Estes são os reflexos e habilidades motoras finas operando a velocidades de milissegundos.

À medida que o robô corta uma cenoura, o Brain 6 modula a força e ajusta o ângulo da lâmina para obter fatias uniformes sem escorregar. É como a "memória muscular" subconsciente do sistema, lidando com detalhes de baixo nível automaticamente.

Cérebro #7:

A peça final é focar na melhoria contínua. Durante e após a preparação do jantar, ele analisa o desempenho. Derramou alguma coisa? Foi muito lento para mexer?

Este módulo usa aprendizado por reforço e autocalibração para atualizar os modelos do robô ao longo do tempo. As principais habilidades do robô foram inicialmente treinadas em demonstrações humanas massivas e tentativa e erro, mas você precisa ajustá-las continuamente.

Se descobrir uma técnica de corte em cubos mais eficiente ou uma melhor pegada de espátula, atualiza sua política para que o próximo jantar seja ainda mais tranquilo. Esse cérebro adaptativo permite que o humanóide se torne mais habilidoso com a experiência.

Codec: Operadores em ação

Como a arquitetura do Codec une esses cérebros? Cada "cérebro" é executado como um módulo Operador separado no sistema de IA do robô. A orquestração do Codec Fabric fornece a cada operador seu próprio ambiente seguro e em sandbox.

Ou seja, o módulo de visão, o módulo de linguagem/lógica, o módulo de planejamento, etc., são executados isoladamente, mas se comunicam por meio de interfaces definidas.

Se um módulo travar ou tiver erros, ele não derrubará todo o robô, os outros continuarão funcionando com segurança. Esse design modular também facilita a atualização ou troca de um cérebro sem afetar o resto e a adição de novos operadores especializados conforme necessário.

Essa abordagem de operador suporta diretamente a estrutura multicérebro. Quando você pede o jantar, o cérebro executivo do robô (Cérebro 1) pode criar um operador "chef" dedicado a essa tarefa, enquanto outros operadores lidam com a percepção e o controle em paralelo.

Cada operador só tem acesso aos recursos de que precisa (por exemplo, o agente de receitas pode ter acesso à Internet para buscar instruções, enquanto o agente de controle faz interface apenas com o hardware), o que melhora a segurança.

O design modular e sandbox do Codec é a cola para todas essas diversas habilidades trabalhando juntas, semelhantes aos microsserviços em software, permitindo que o humanóide lide de forma confiável com tarefas complexas, como preparar o jantar do zero.

É por isso que $CODEC será a principal infraestrutura para a robótica.

23 de ago., 18:30

Você verá modelos de base para Humanóides continuamente usando uma arquitetura de estilo System 2 + System 1 que é realmente inspirada na cognição humana.

A maioria dos modelos de visão-linguagem-ação (VLA) hoje são construídos como sistemas multimodais centralizados que lidam com percepção, linguagem e ação em uma única rede.

A infraestrutura do Codec é perfeita para isso, pois trata cada operador como um módulo em sandbox. O que significa que você pode ativar vários operadores em paralelo, cada um executando seu próprio modelo ou tarefa, mantendo-os encapsulados e coordenados por meio da mesma arquitetura.

Robôs e humanóides em geral normalmente têm vários cérebros, onde um operador pode lidar com o processamento da visão, outro lidar com o equilíbrio, outro fazer planejamento de alto nível, etc., que podem ser coordenados através do sistema do Codec.

O modelo básico da Nvidia, Issac GR00T N1, usa a arquitetura de dois módulos System 2 + System 1. O Sistema 2 é um modelo de linguagem de visão (uma versão do PaLM ou similar, multimodal) que observa o mundo através das câmeras do robô e ouve as instruções, depois faz um plano de alto nível.

O Sistema 1 é uma política de transformador de difusão que pega esse plano e o transforma em movimentos contínuos em tempo real. Você pode pensar no Sistema 2 como o cérebro deliberativo e no Sistema 1 como o controlador do corpo instintivo. O Sistema 2 pode produzir algo como "mova para o copo vermelho, segure-o e coloque-o na prateleira", e o Sistema 1 gerará as trajetórias articulares detalhadas para as pernas e braços para executar cada etapa sem problemas.

O Sistema 1 foi treinado em toneladas de dados de trajetória (incluindo demonstrações teleoperadas humanas e dados simulados de física) para dominar movimentos finos, enquanto o Sistema 2 foi construído em um transformador com pré-treinamento na Internet (para compreensão semântica).

Essa separação de raciocínio versus ação é muito poderosa para a NVIDIA. Isso significa que o GR00T pode lidar com tarefas de longo horizonte que requerem planejamento (graças ao System 2) e também reagir instantaneamente a perturbações (graças ao System 1).

Se um robô estiver carregando uma bandeja e alguém cutucar a bandeja, o Sistema 1 pode corrigir o equilíbrio imediatamente, em vez de esperar que o Sistema 2 mais lento perceba.

O GR00T N1 foi um dos primeiros modelos de base robótica disponíveis abertamente e rapidamente ganhou força.

Fora da caixa, ele demonstrou habilidade em muitas tarefas de simulação, ele poderia agarrar e mover objetos com uma mão ou duas, itens de mão entre as mãos e realizar tarefas de várias etapas sem qualquer programação específica da tarefa. Como não estava vinculado a uma única modalidade, os desenvolvedores mostraram que ele funcionava em diferentes robôs com ajustes mínimos.

Isso também é verdade para o Helix (modelo de fundação da Figure), que usa esse tipo de arquitetura. O Helix permite que dois robôs ou várias habilidades operem, o Codec pode habilitar um cérebro multiagente executando vários operadores que compartilham informações.

Esse design de "pod isolado" significa que cada componente pode ser especializado (assim como o Sistema 1 vs Sistema 2) e até mesmo desenvolvido por equipes diferentes, mas eles podem trabalhar juntos.

É uma abordagem única no sentido de que a Codec está construindo a pilha de software profunda para suportar essa inteligência modular e distribuída, enquanto a maioria dos outros se concentra apenas no próprio modelo de IA.

O codec também aproveita grandes modelos pré-treinados. Se você estiver criando um aplicativo de robô nele, poderá conectar um modelo de base OpenVLA ou Pi Zero como parte de seu operador. O codec fornece os conectores, fácil acesso a feeds de câmera ou APIs de robôs, para que você não precise escrever o código de baixo nível para obter imagens da câmera de um robô ou enviar comandos de velocidade para seus motores. Tudo é abstraído por trás de um SDK de alto nível.

Uma das razões pelas quais estou tão otimista com o Codec é exatamente o que descrevi acima. Eles não estão perseguindo narrativas, a arquitetura é construída para ser a cola entre os modelos de fundação e suporta sem atrito sistemas multicerebrais, o que é crítico para a complexidade humanóide.

Como estamos tão no início dessa tendência, vale a pena estudar os designs dos líderes do setor e entender por que eles funcionam. A robótica é difícil de entender, dadas as camadas de hardware e software, mas uma vez que você aprende a dividir cada seção peça por peça, fica muito mais fácil de digerir.

Pode parecer uma perda de tempo agora, mas esse é o mesmo método que me deu uma vantagem durante o AI szn e por que eu estava no início de tantos projetos. Torne-se disciplinado e aprenda quais componentes podem coexistir e quais componentes não são dimensionados.

Vai pagar dividendos nos próximos meses.

Deca Trillions ( $CODEC ) codificado.

7,55K

Melhores

Classificação

Favoritos