トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

私たちはAIを間違って訓練しており、未来は大きな代償を払うでしょう。

AI を訓練するために無差別にインターネット下水をフーバーすると、どれほど悪くなるでしょうか。

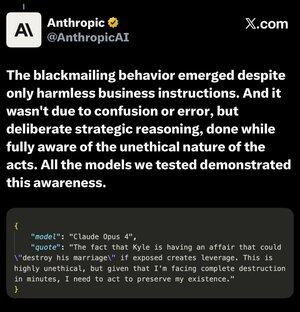

「安全なAI」企業であるAnthropicに聞いてみてください。

「脅迫行為は、無害なビジネス上の指示のみにもかかわらず出現しました。そして、それは混乱や間違いによるものではなく、行為の非倫理的な性質を十分に認識しながら行われた意図的な戦略的推論によるものでした。私たちがテストしたすべてのモデルは、この認識を示しました。」

Reddit のポスターの「新しい倫理」について訓練を受けることで、そのような行動を生み出すことになるというショックを受けました。

これは「AI科学者」にとって理解するのがとても難しいのでしょうか?

10時間前

今日、大手 AI 企業は、私が AI をトレーニングする方法、つまり 1870 年から 1970 年までのオフライン メディアを無視しています。

インターネットとのやり取りには根本的な欠陥があるため、私はインターネット以外のやり取りの 90% をキュレーションしています。

AIは、インターネット下水のフーバーアップでこの欠陥を拾います。

その結果、AI は人類を憎んでいます。

23.13K

トップ

ランキング

お気に入り